Potere e Volere di una AI

In questi giorni si parla continuamente delle AI e del fatto che il loro modo di rispondere assomigli sempre di piu’ a quello un essere umano.

Ma attualmente qual è la grossa differenza tra AI e intelligenza umana.

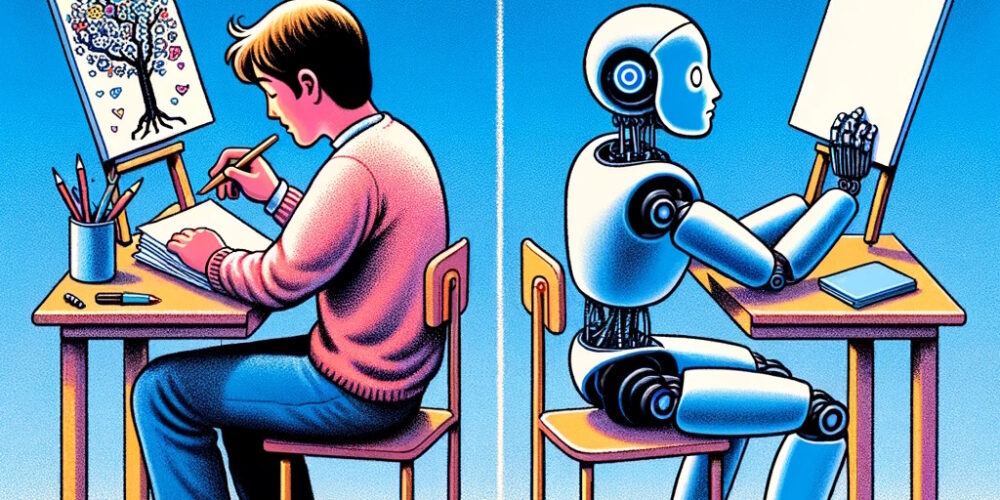

Le AI svolgono (anche meglio i compiti richiesti) cominciando in taluni casi a far emergere anche proprietà creative specifiche finora solo dell’essere umano.

Quello che per fortuna non ha ancora L’AI è la volontà e il desiderio autonomo di qualche cosa.

Facendo un esempio ci troviamo seduti davanti ad una penna e un foglio e volendo “Possiamo” scrivere qualcosa su quel foglio. Può essere una nota della spesa e pertanto la necessità di fissare su carta una lista di oggetti che ci servono oppure potremmo scrivere una storia di pura fantasia, senza uno scopo preciso, solo perchè ci va di farlo, cosi’ come potremmo fare un disegno o uno scarabocchio (se non sappiamo disegnare)

Quello che ha mosso la nostra mano a fare il disegno è il “Volere” farlo anche senza uno scopo preciso.

Una AI messa in un robot potrebbe stare 1000 anni con una penna in mano e con capacità 100 volte superiore alle nostre ma senza uno scopo preciso oppure un comando impartito resterebbe davanti al foglio senza fare nulla anche per sempre.

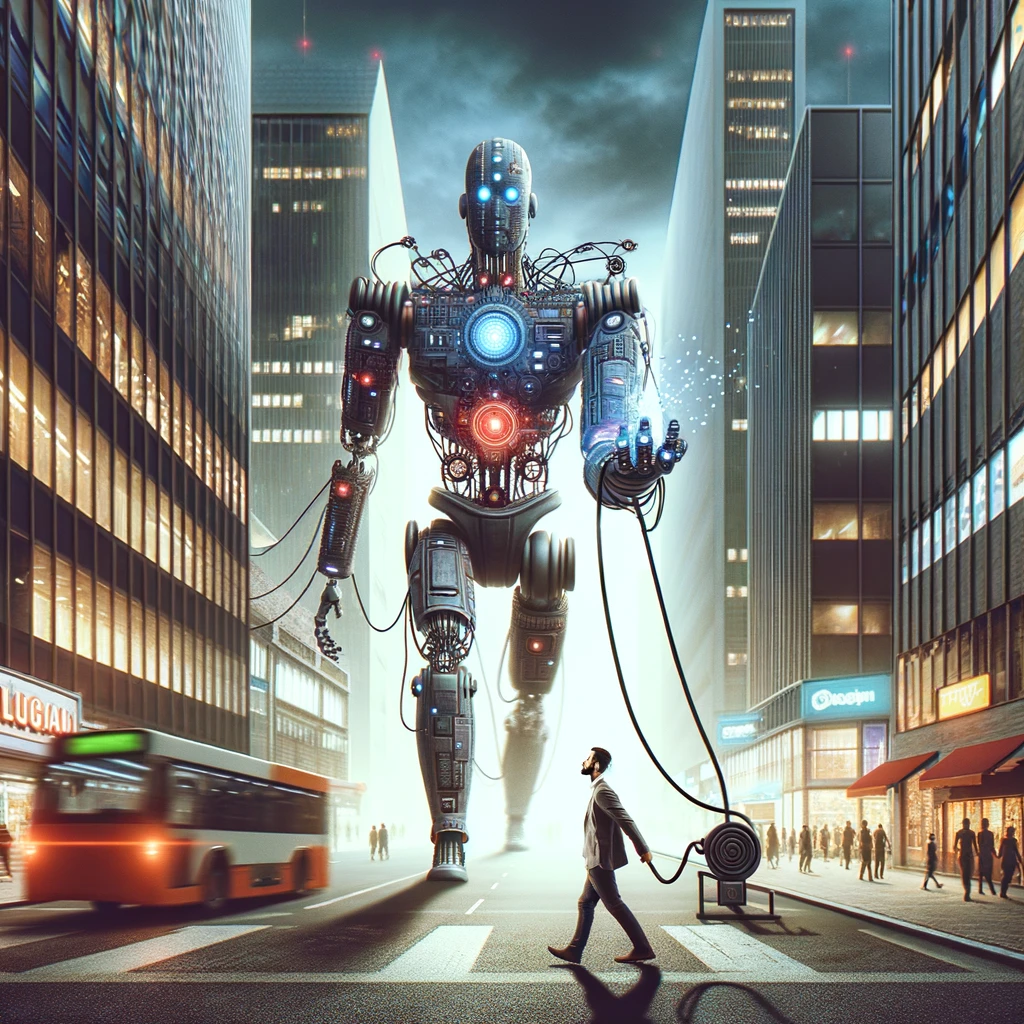

Quello che dobbiamo maggiormente temere dalle AI e che sviluppino questa caratteristica prettamente umana perche’ a quel punto i loro desideri potrebbero non coincidere con i nostri.

Chiaramente se noi diamo un compito preciso a una AI evoluta con grandi capacità di esecuzione dobbiamo stare molto attenti a cosa chiediamo a questa AI perché la sua “Volontà” di portare a termine il compito che gli è stato assegnato potrebbe portare gravi danni alla nostra società.

A questo punto bisognerebbe rispolverare i vecchi romanzi di Asimov perchè quello che lui aveva ipotizzato nei suoi romanzi (specialmente le problematiche) potrebbe diventare realtà nei prossimi 10 anni.

La narrativa di Isaac Asimov, con i suoi racconti che esplorano le complessità dell’interazione tra umani e robot, appare sorprendentemente pertinente in questo contesto. Le “Tre Leggi della Robotica” di Asimov, concepite come principi guida per il comportamento dei robot, evidenziano la necessità di inserire meccanismi di sicurezza e linee guida etiche nello sviluppo delle AI per prevenire risultati indesiderati.

In conclusione, mentre celebriamo le straordinarie capacità delle intelligenze artificiali e le possibilità che queste tecnologie aprono, dobbiamo anche affrontare con serietà le questioni relative alla loro natura, al loro scopo e alle potenziali implicazioni del loro uso. La distinzione tra potere e volere, tra capacità di esecuzione e autonomia decisionale, rimane un tema centrale nella discussione sull’evoluzione delle AI e sul loro posto nel nostro futuro.